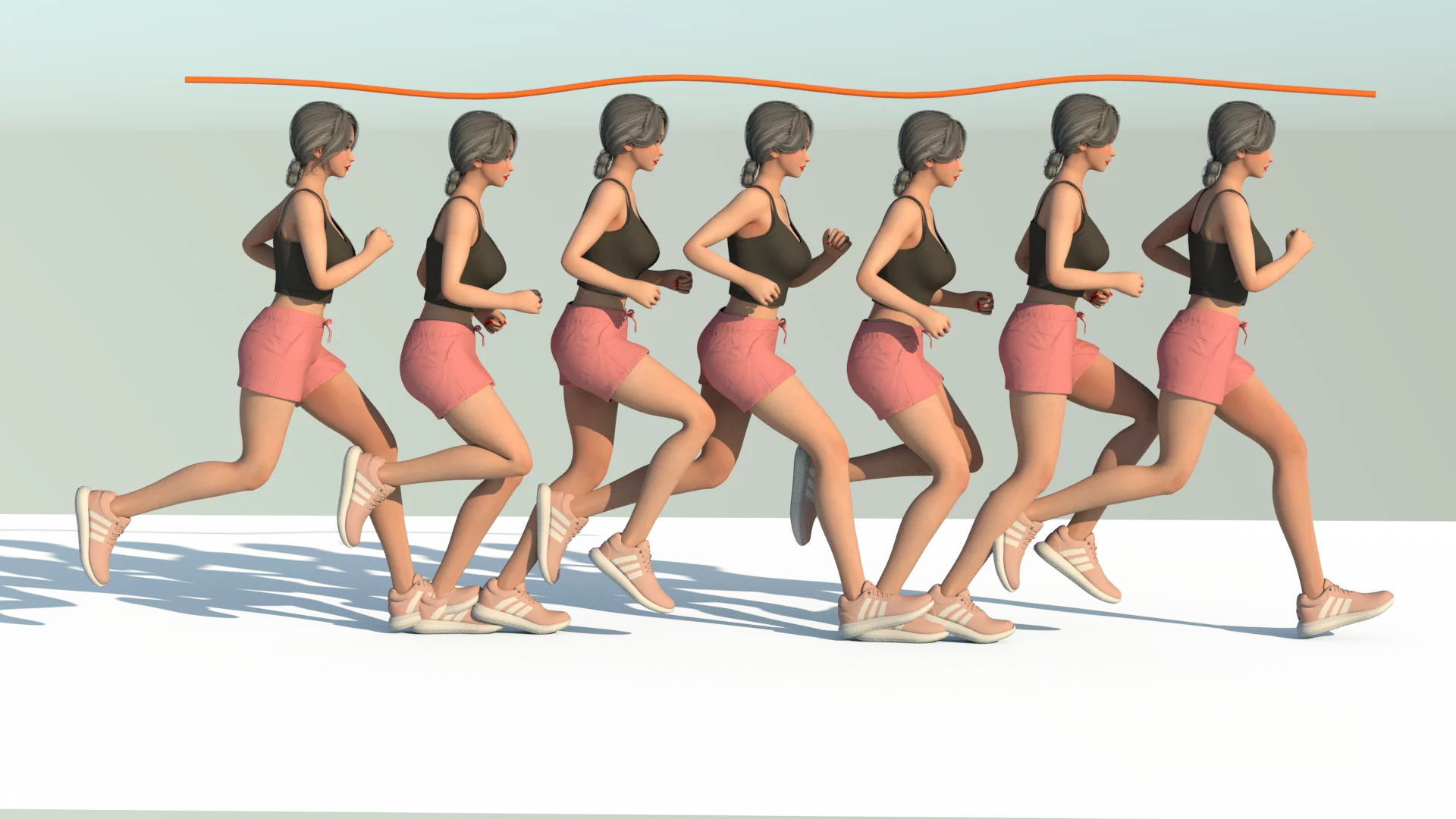

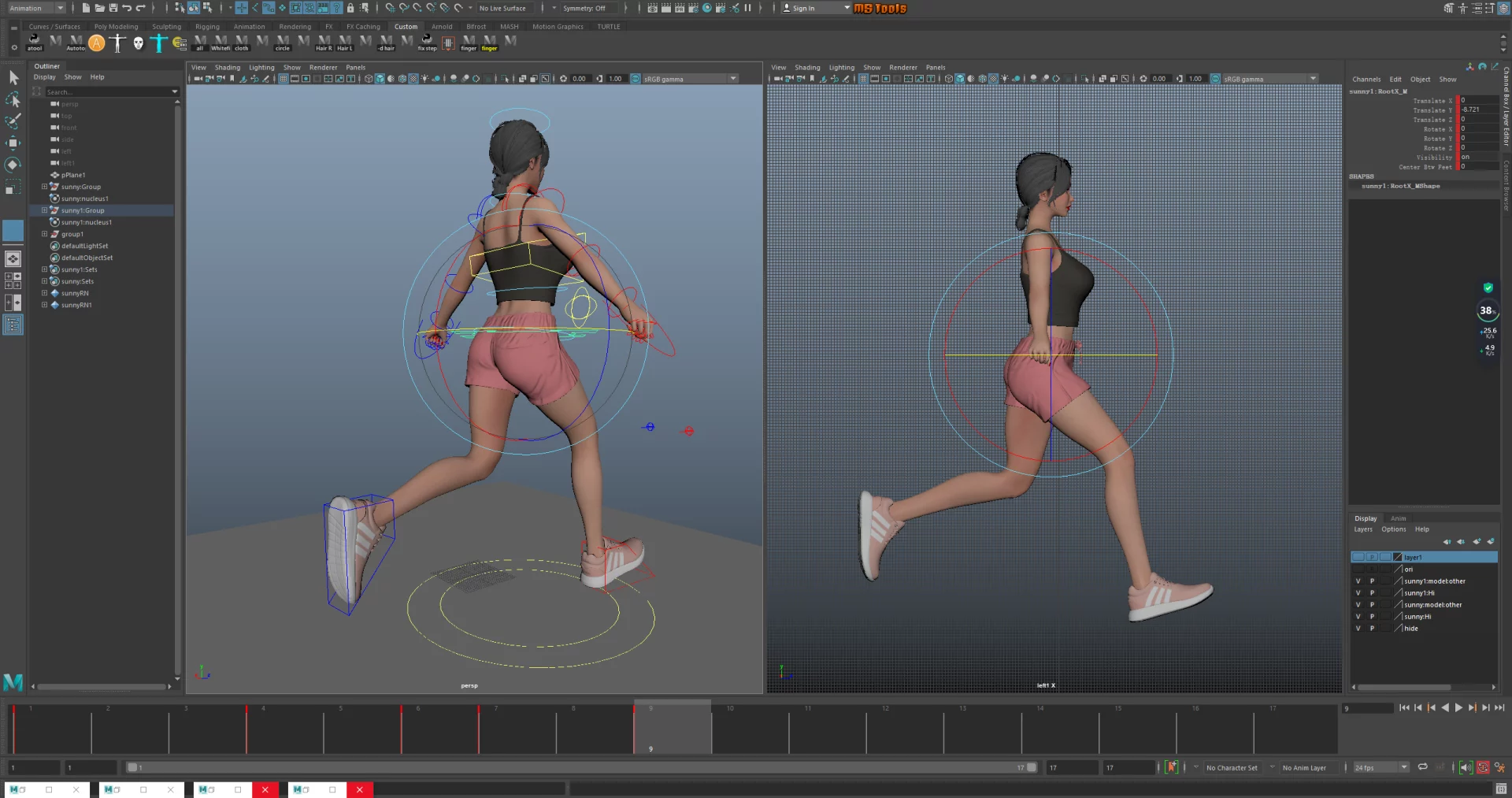

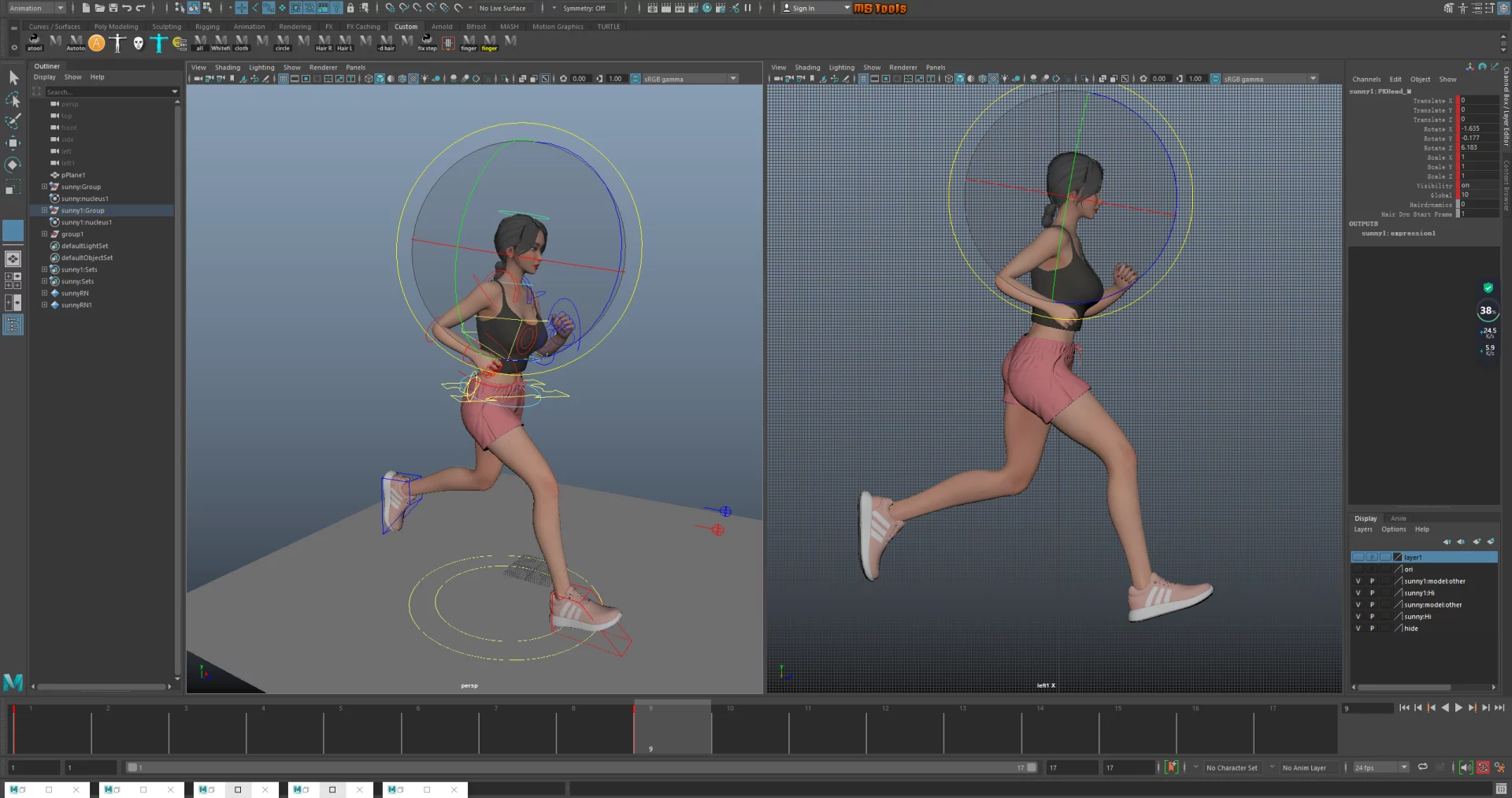

今天我们来看下在玛雅中怎么去制作一个人物慢跑的动画。一样的,我们采用24FPS,17帧的长度来制作这个动画。

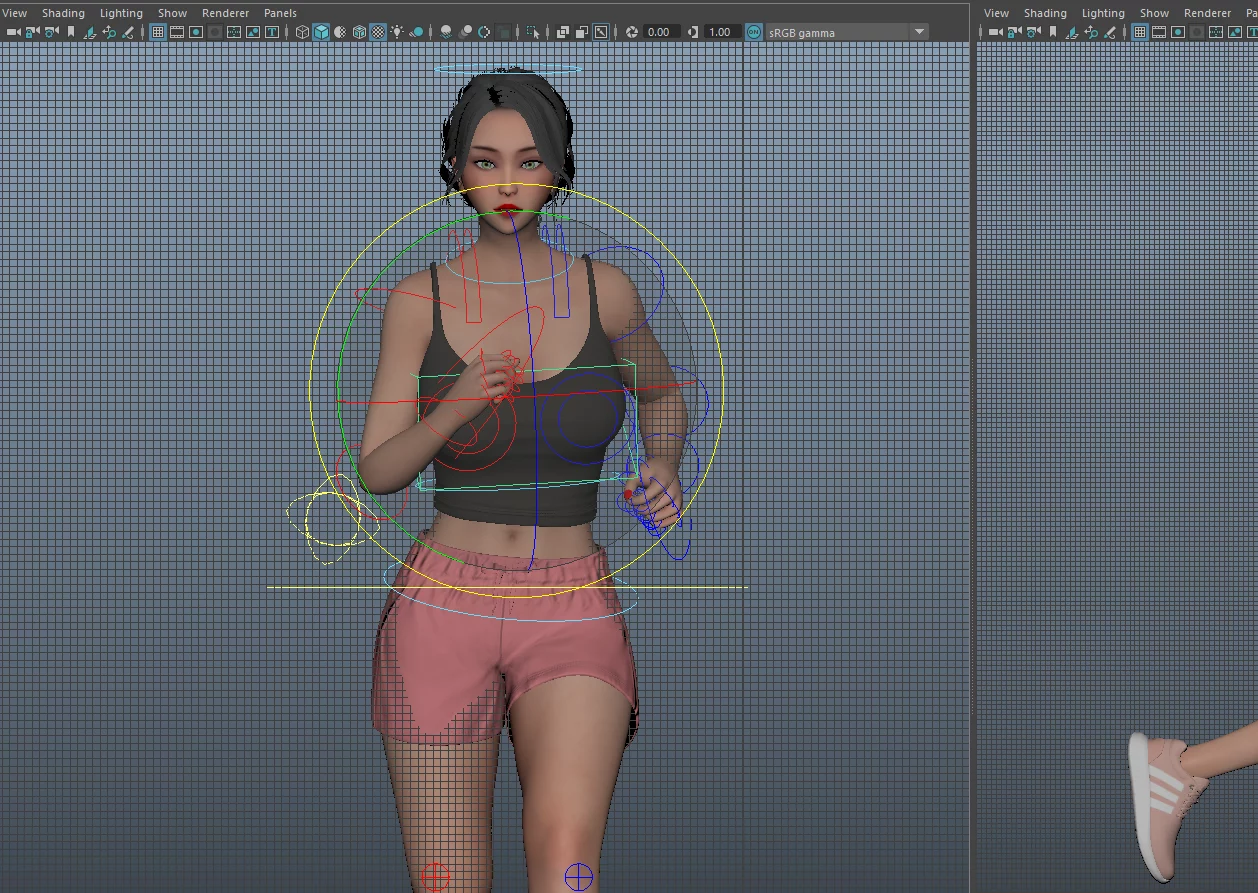

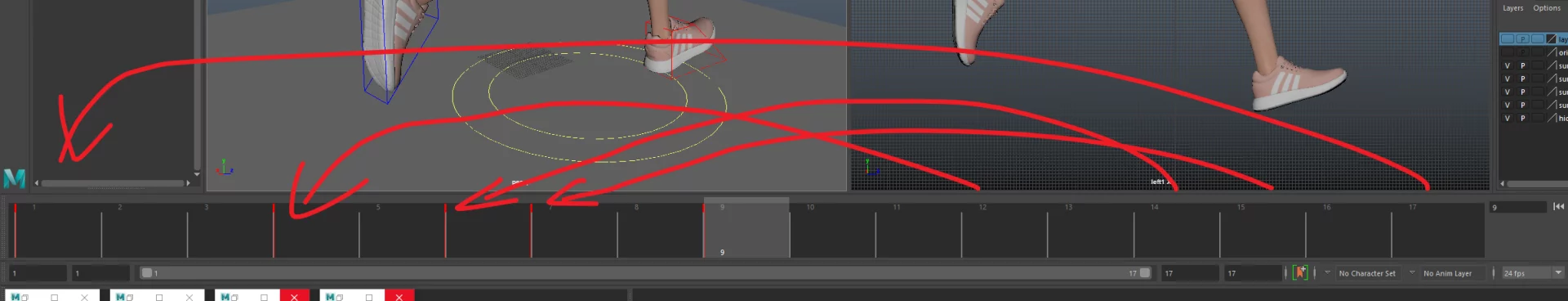

首先我们在关键帧的地方先标记上书签,方便我们K帧。

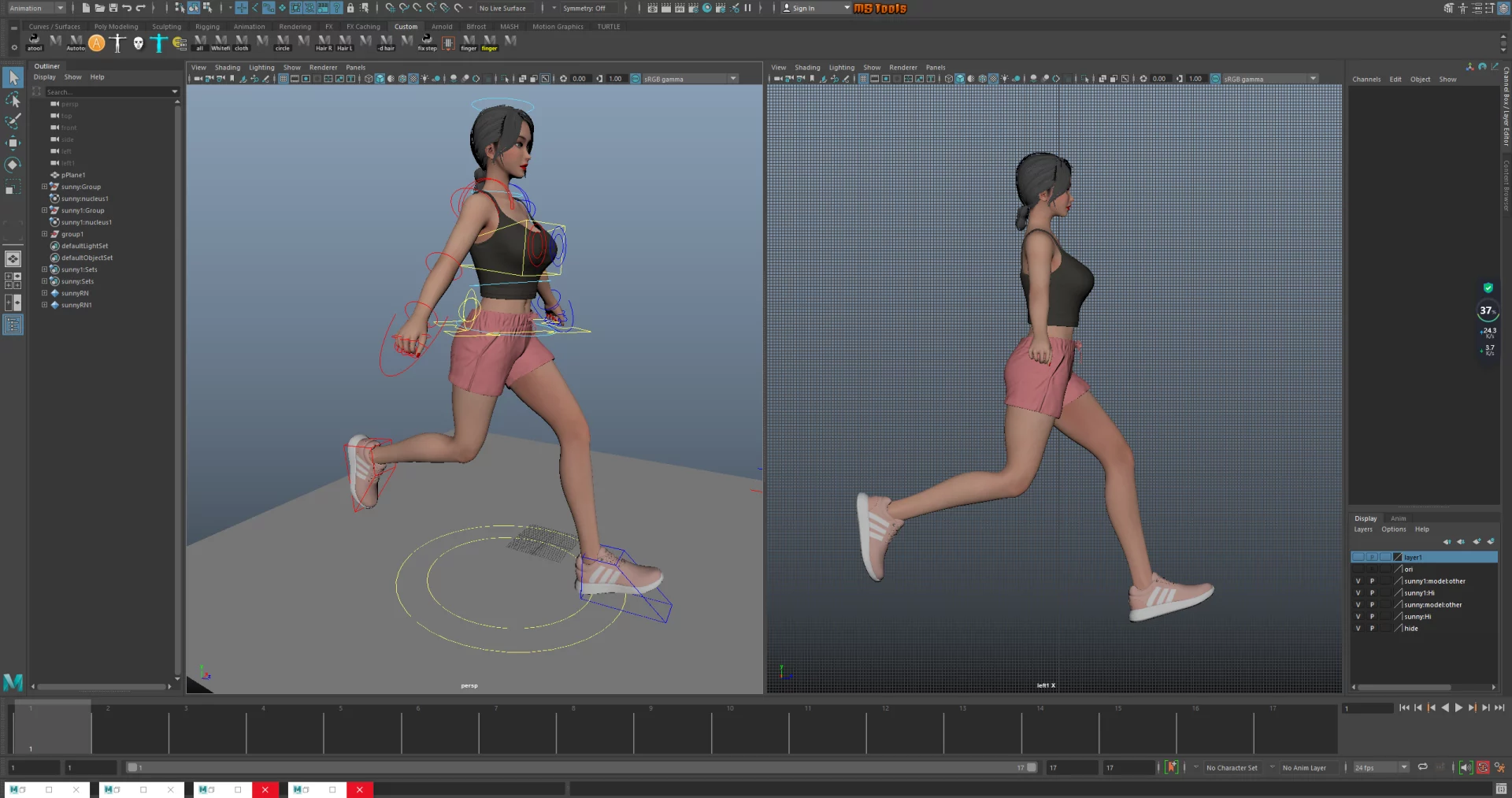

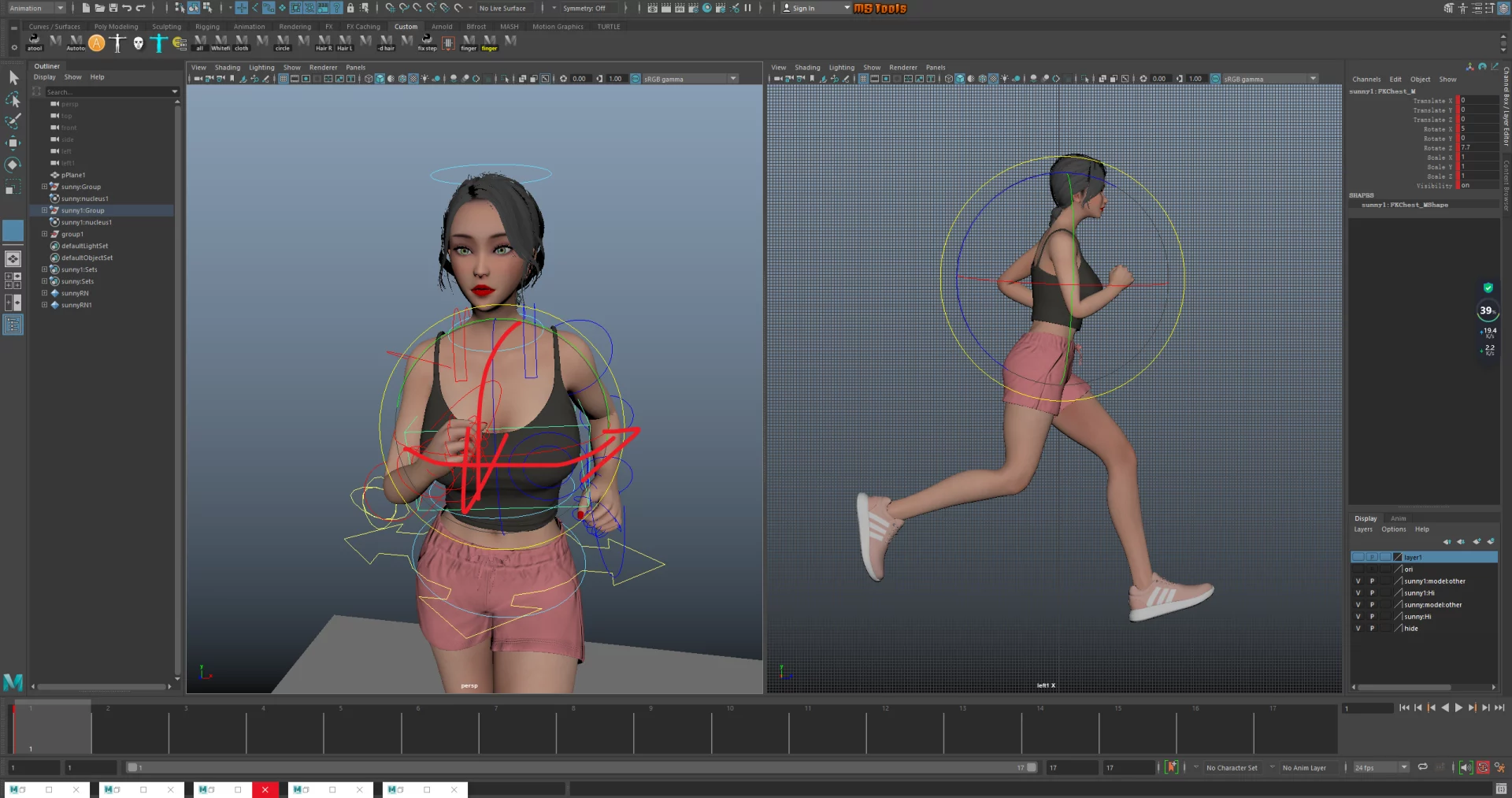

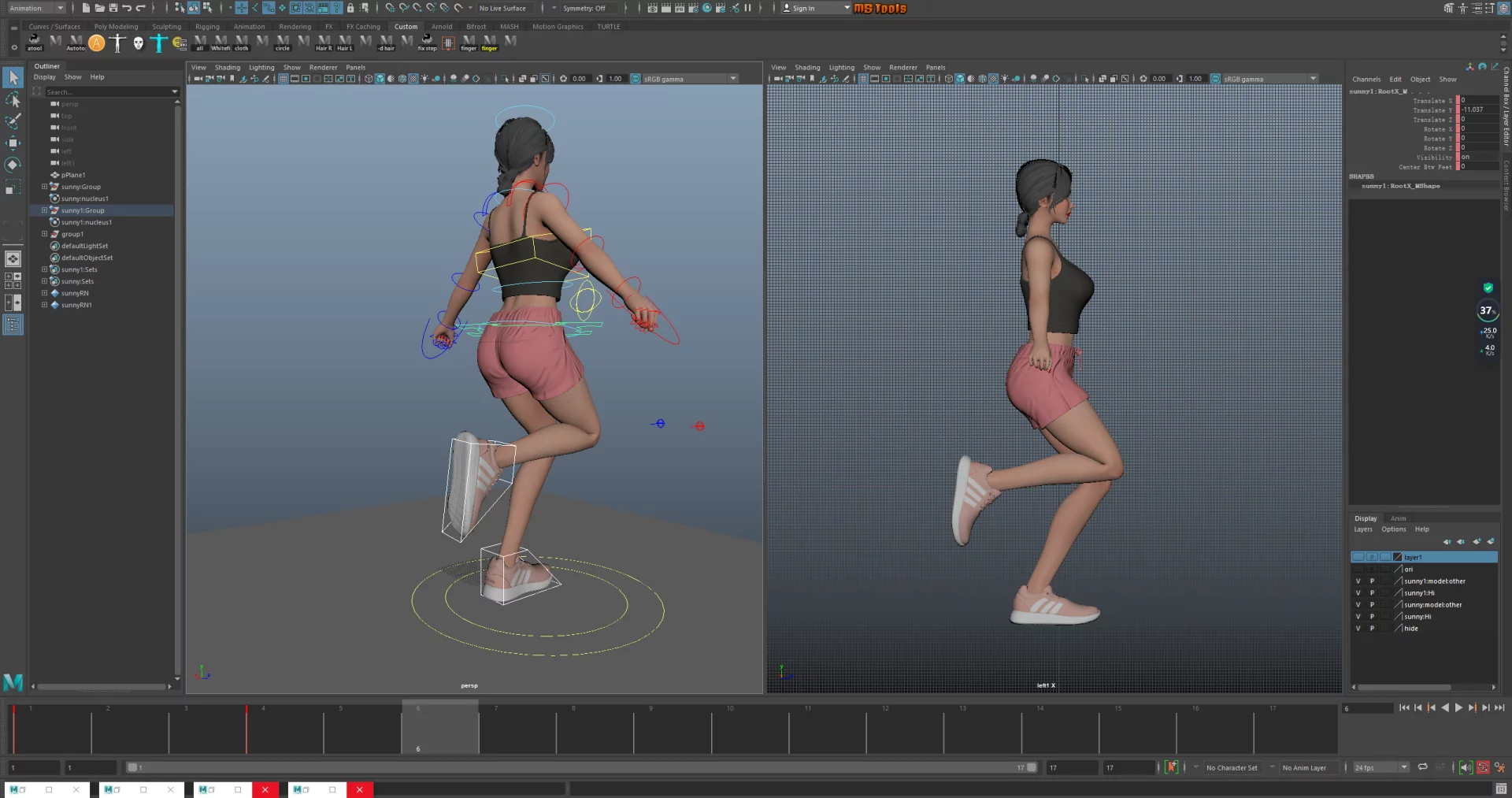

标记完以后,我们开始来制作第一个接触地面的关键pose,我们选择双腿和重心控制器,在第一帧设置关键帧。此时,我们重心下压制半蹲的状态,前脚刚好接触地面,后脚离开地面。

然后,我们再第4帧制作第二个向下的关键pose,此时,我们的重心大幅度的下压,前脚刚好踩到地面,后脚收至前脚关节的位置。

然后,我们再第6帧制作第三个向上的过渡pose,此时,我们的重心大幅度的向上,前脚向后垫一点脚尖,后脚持续向前移动。

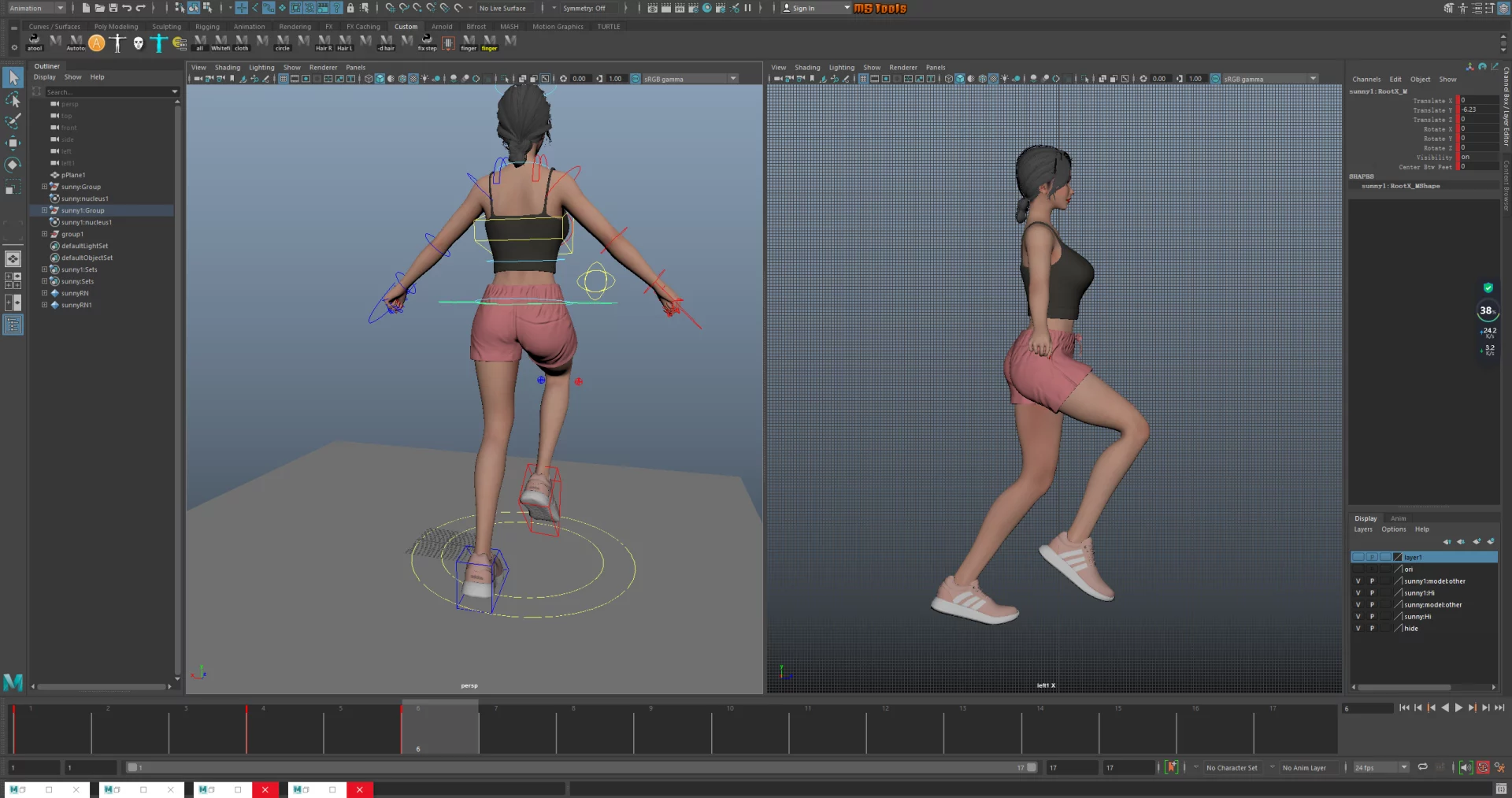

那么在,第7帧,这里我们要单独对重心做一个微微上移的操作,一点点就好了。然后我们接着在第9帧制作第四个接触地面的关键pose,它与第1帧是相反的pose,动作都是一样的。

那么后面的第12帧、14帧、15帧、17帧都分别对应了前面的1帧、4帧、6帧、7帧和1帧,重心规律都一样,我们跟着做就可以了。第17帧,我们直接把第1帧的pose复制过来用。

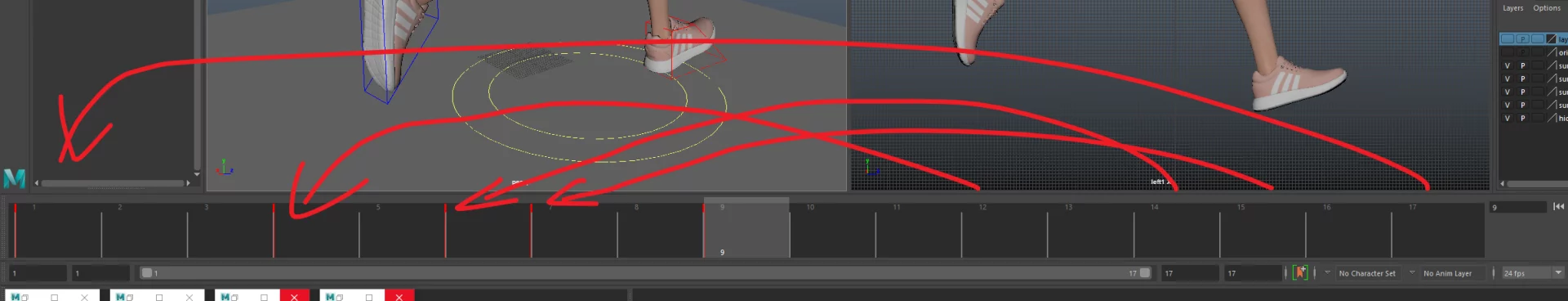

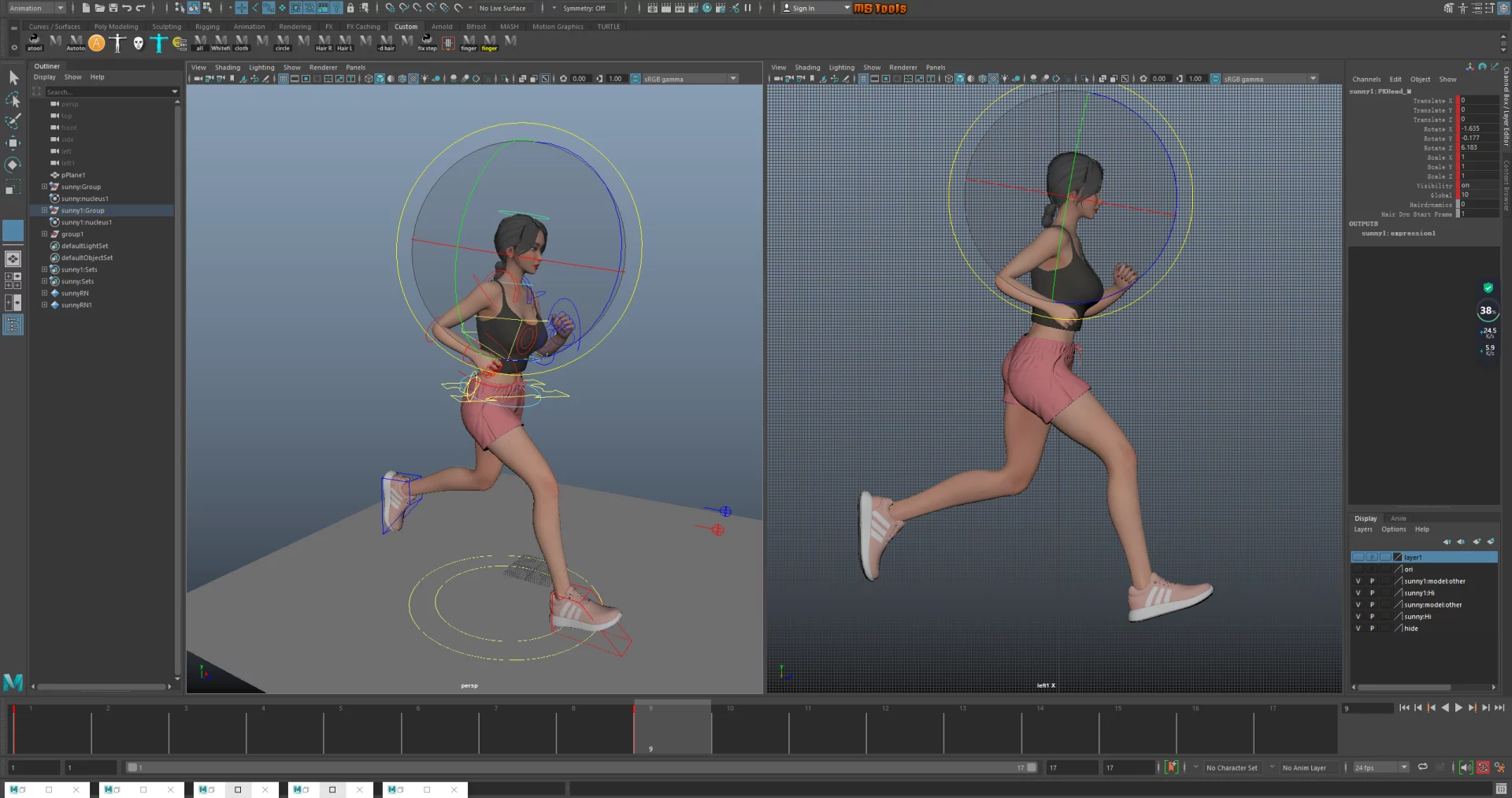

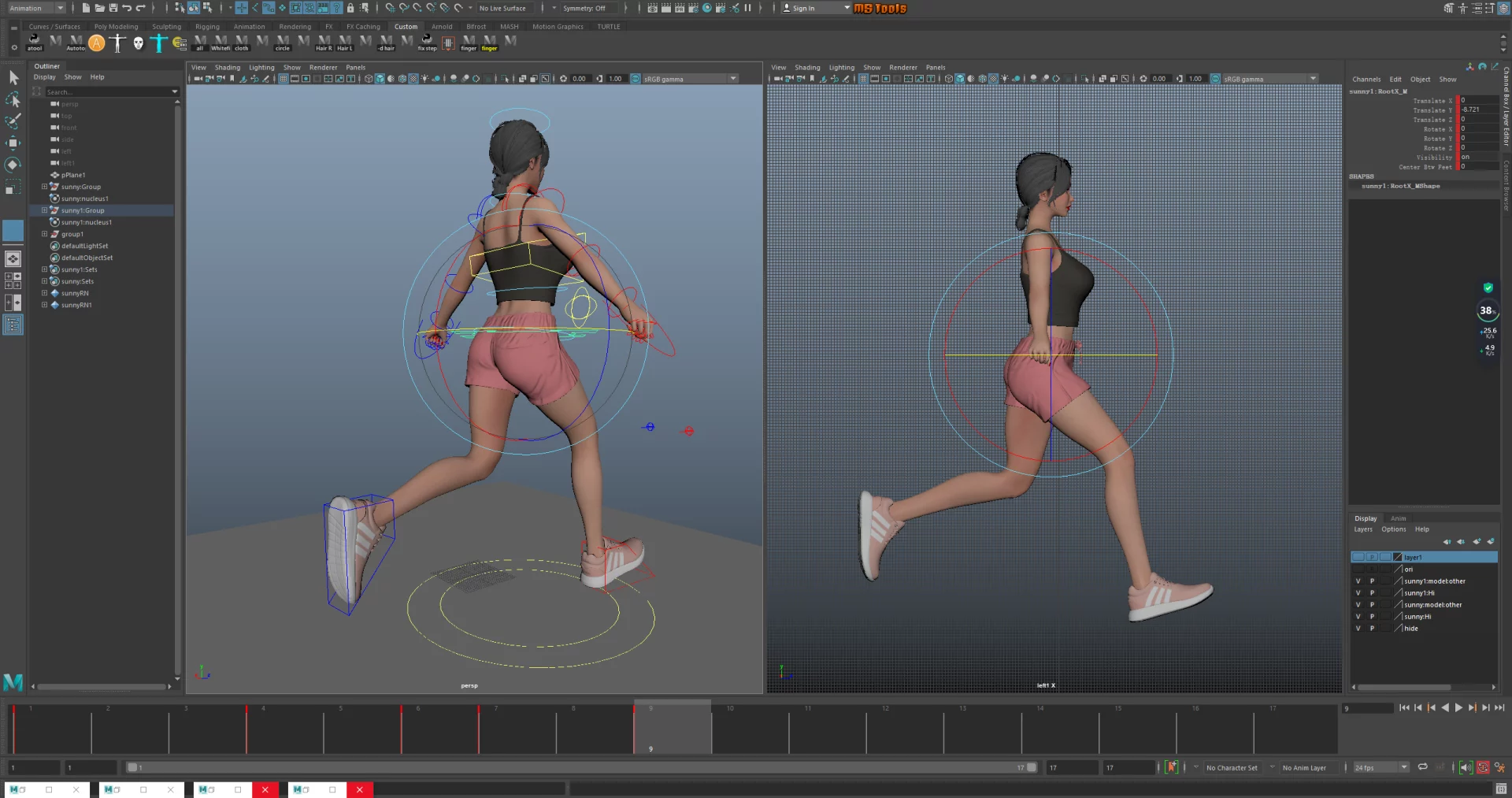

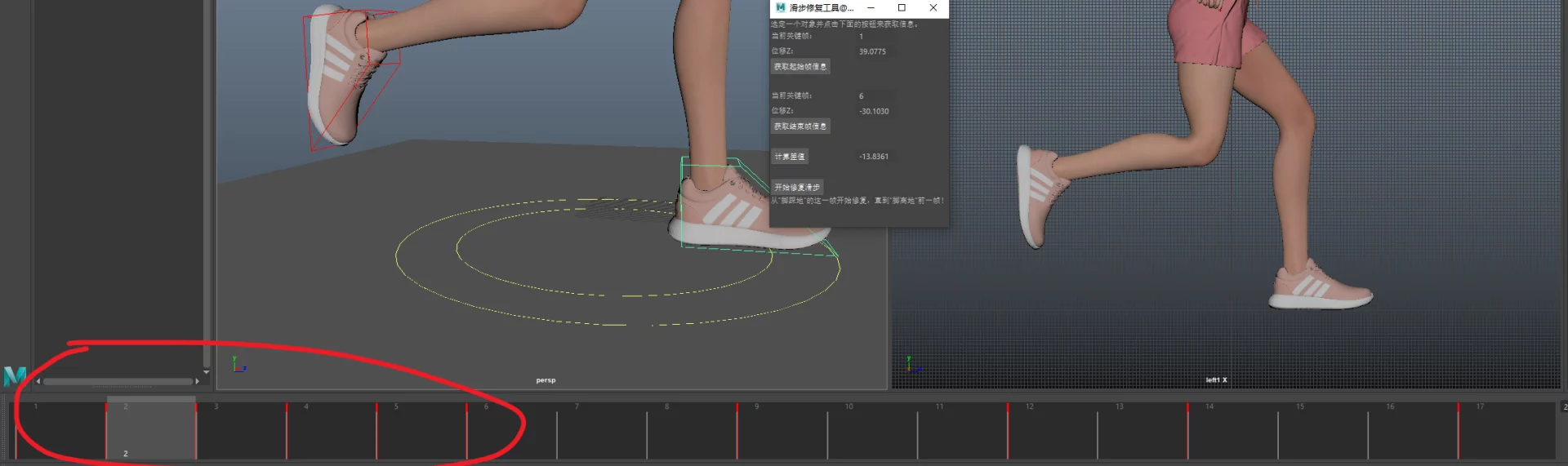

这样,一个大概的跑步框架就被我们制作出来了。现在我们开始来修复滑步,我们打开Python滑步工具,我们在踩地的第1帧获取起始帧信息,然后在离开地面的第6帧获取结束帧信息。我们计算位移差,然后再第1帧开始修复,直到第6帧结束。另外这只脚,我们在踩地的第9帧开始修复,直到第14帧结束。这样我们滑步就修复好了。

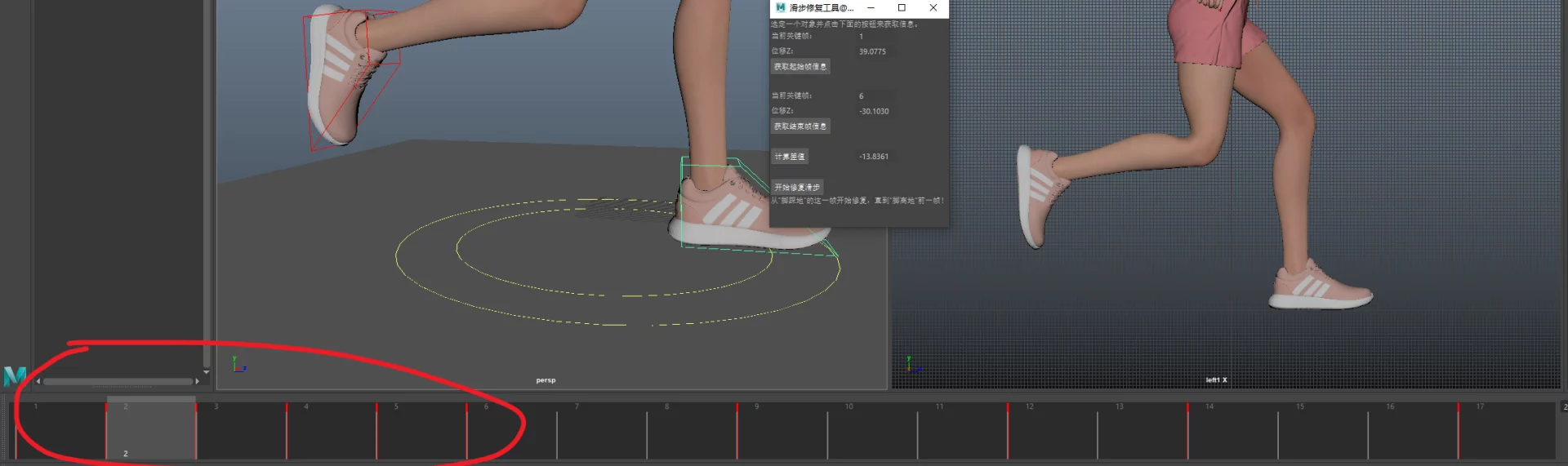

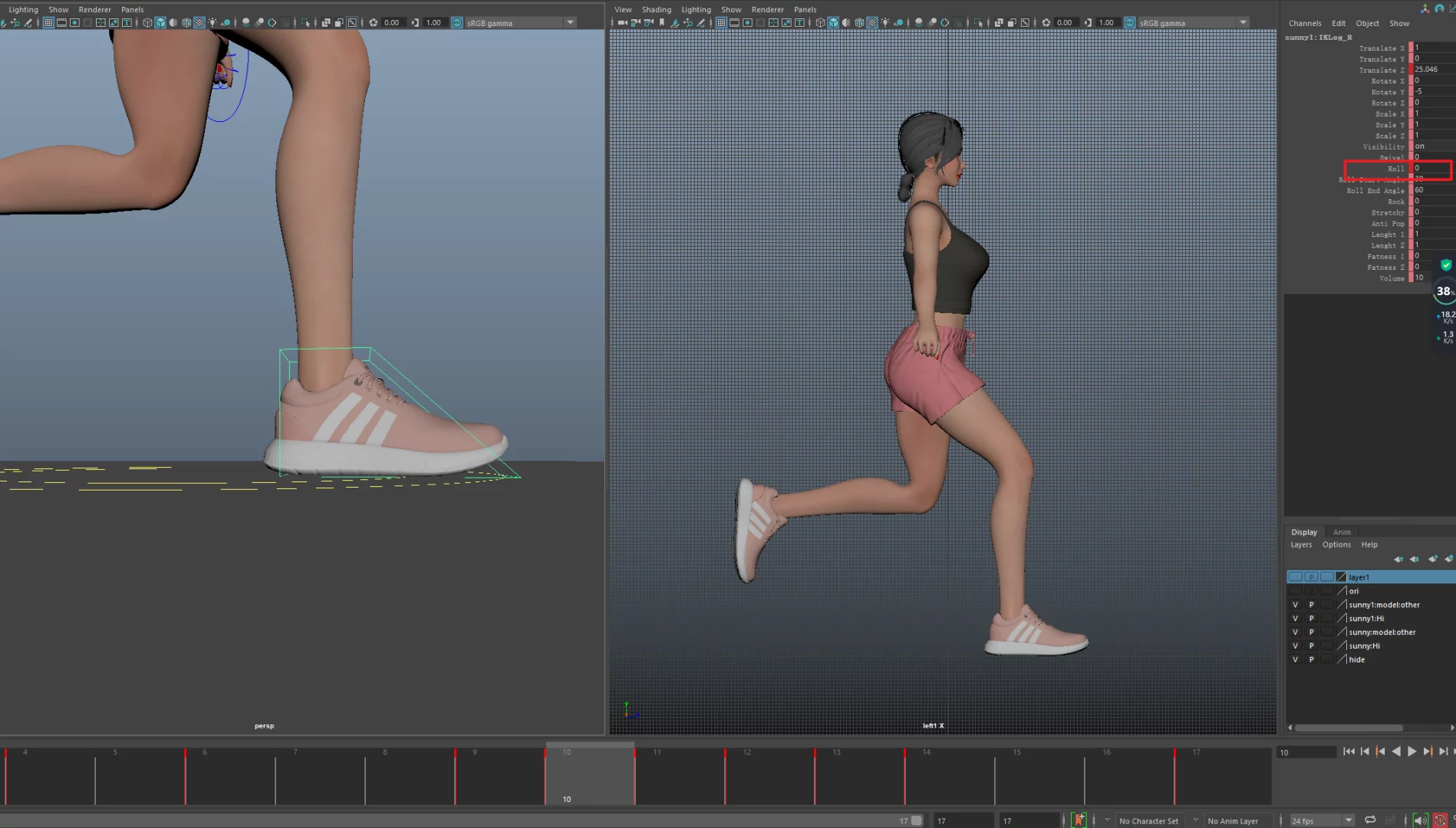

那么这里。还存在一个问题就是从接触地面到完全踩地,我们只需要一帧完成,所以我们在脚接触地面的后一帧,把旋转参数设置为0,这样脚部的动作就自然了。

接着我们来处理这个脚,我们需要让它在踩地的时候位于人物下方,我们只要打开曲线图编辑器。我们需要处理这个控制平移的X轴,这里我们需要选中踩地的关键帧,然后统一的向内移动。另一只脚也是一样的,选中踩地的帧,然后,统一的向内移动。这个度需要我们自己去把握,最好两只脚比较接近就可以了。

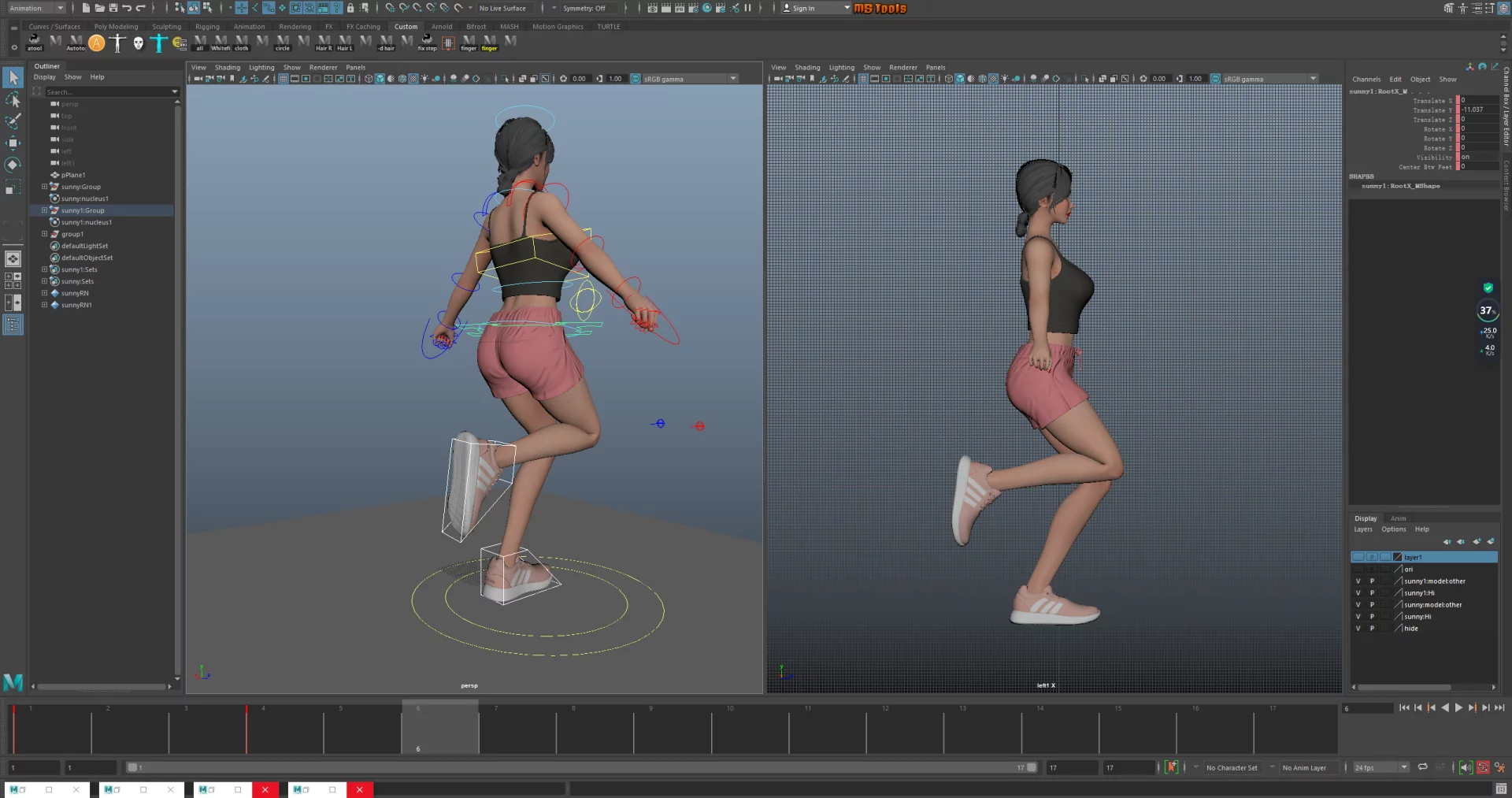

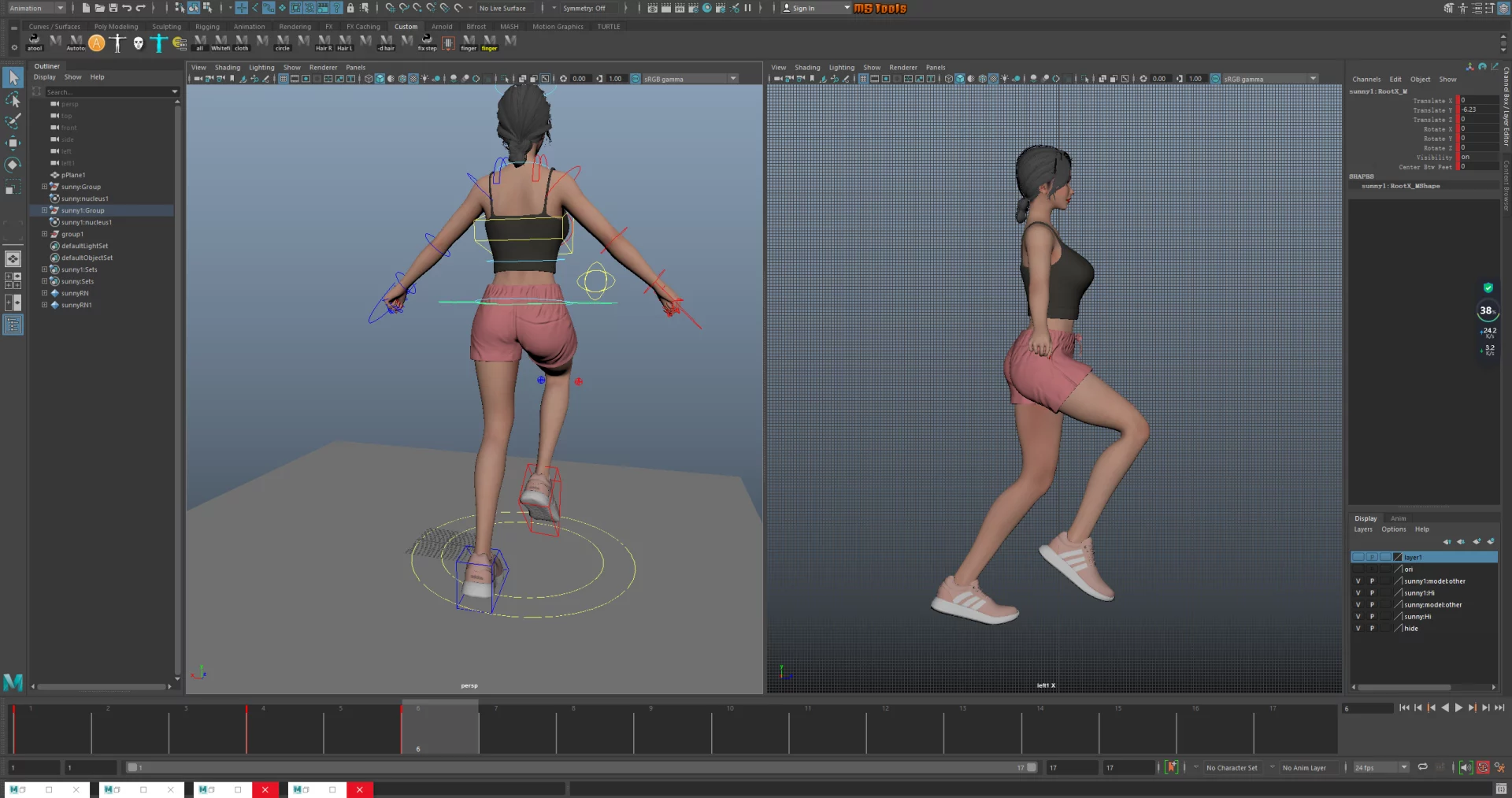

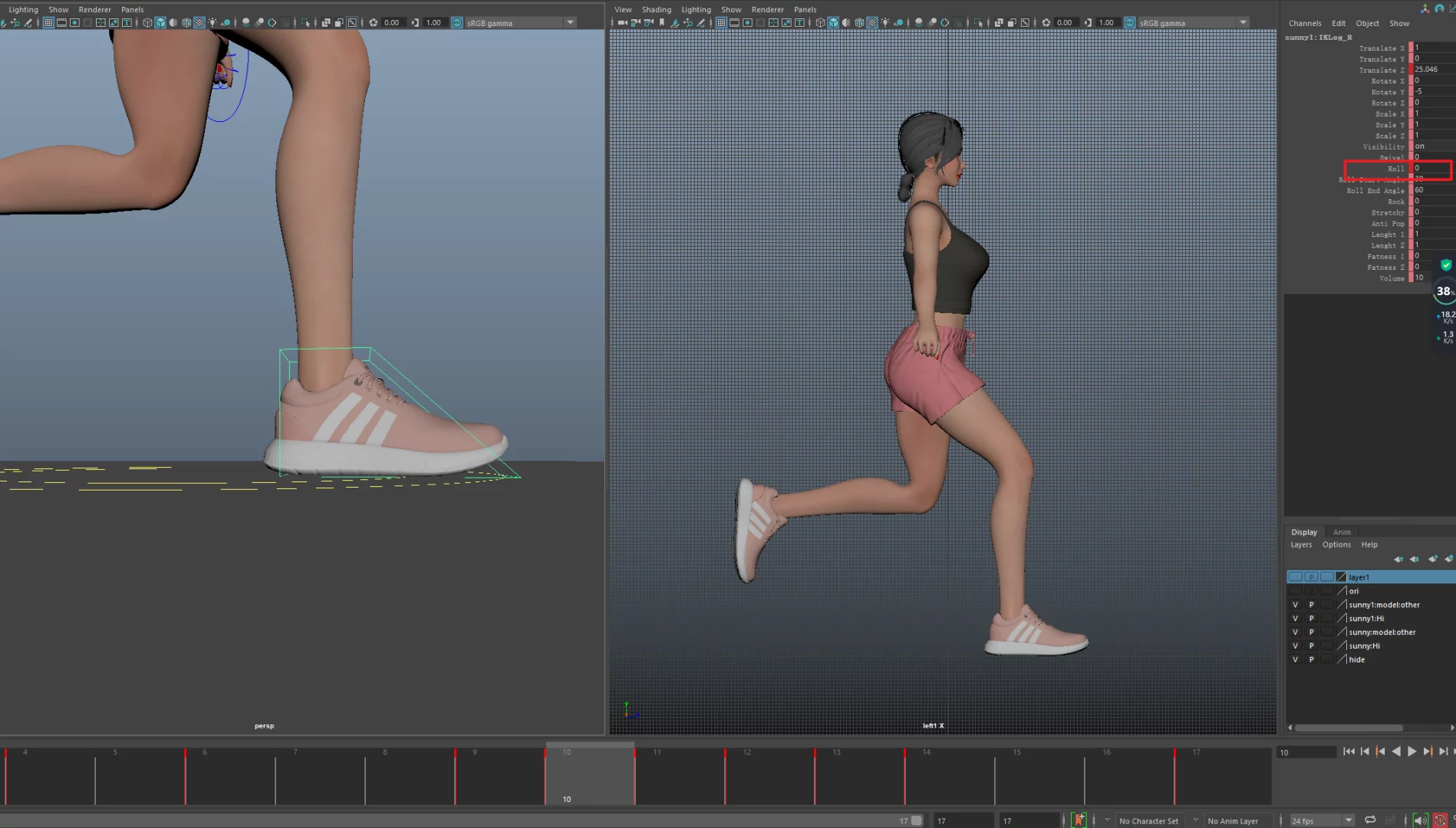

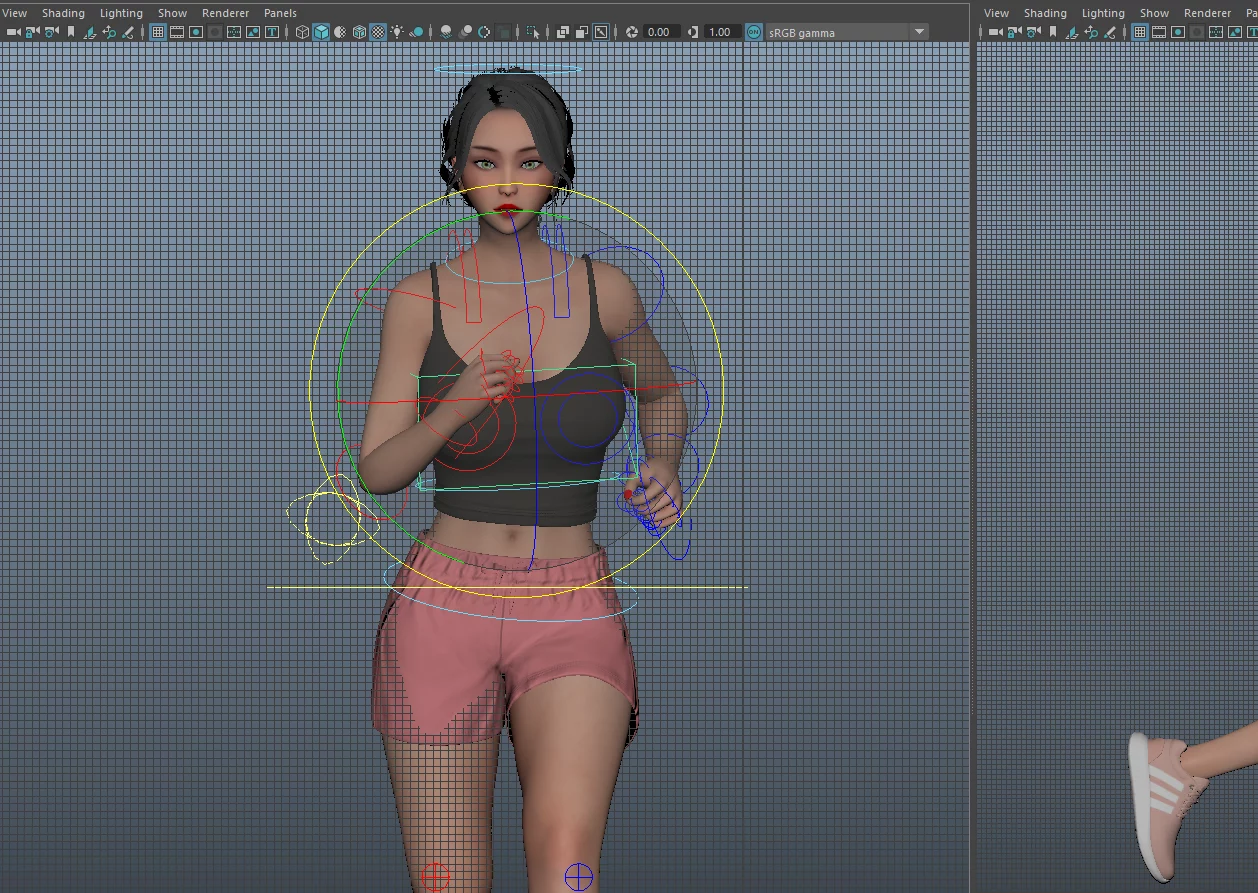

接着,我们框选上半身的控制器,在第1帧,9帧,17帧设置关键帧,我们来调节一下剩余部分的动画。

首先我们选择次级重心控制器,前脚踩地,我们就朝着踩地的方向去倾斜。胯部朝着后脚的方向去旋转。腰部,我们做一个对应的次级重心的修正。接着我们把手臂的pose摆一下。胸部在修正身体基础pose的同时,我们需要它朝着向后手臂的方向旋转一些。头部我们让它正常的看向前方的路就可以了。

接着,我们在第9帧调第17帧的反pose,一样的,我们选择次级重心控制器,前脚踩地,我们就朝着踩地的方向去倾斜。胯部朝着后脚的方向去旋转。腰部,我们做一个对应的次级重心的修正。接着我们把手臂的pose摆一下。胸部在修正身体基础pose的同时,我们需要它朝着向后手臂的方向旋转一些。头部我们让它正常的看向前方的路就可以了。

那么第1帧和第17帧是一样的,我们直接把第17帧的关键帧复制过来。

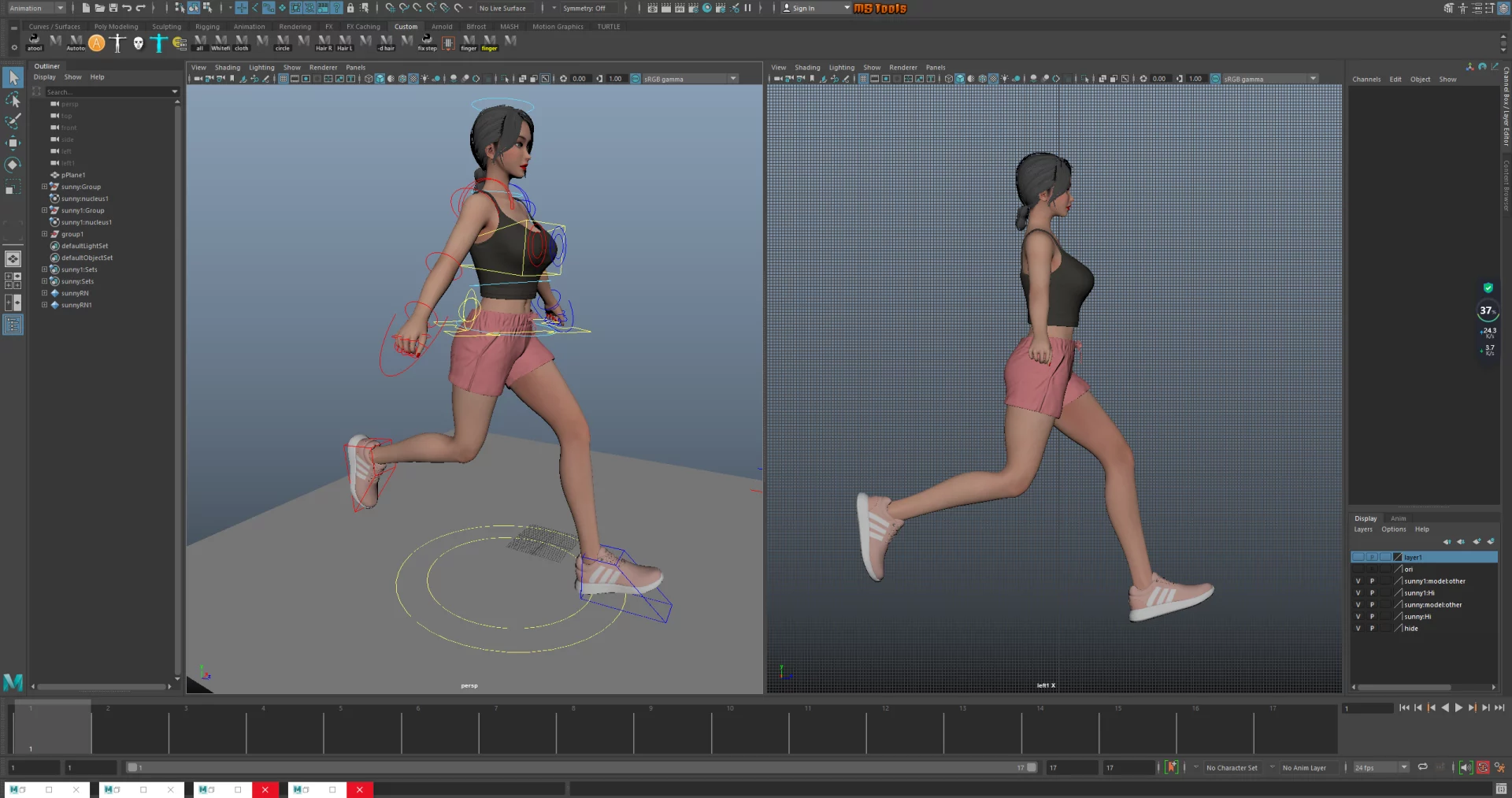

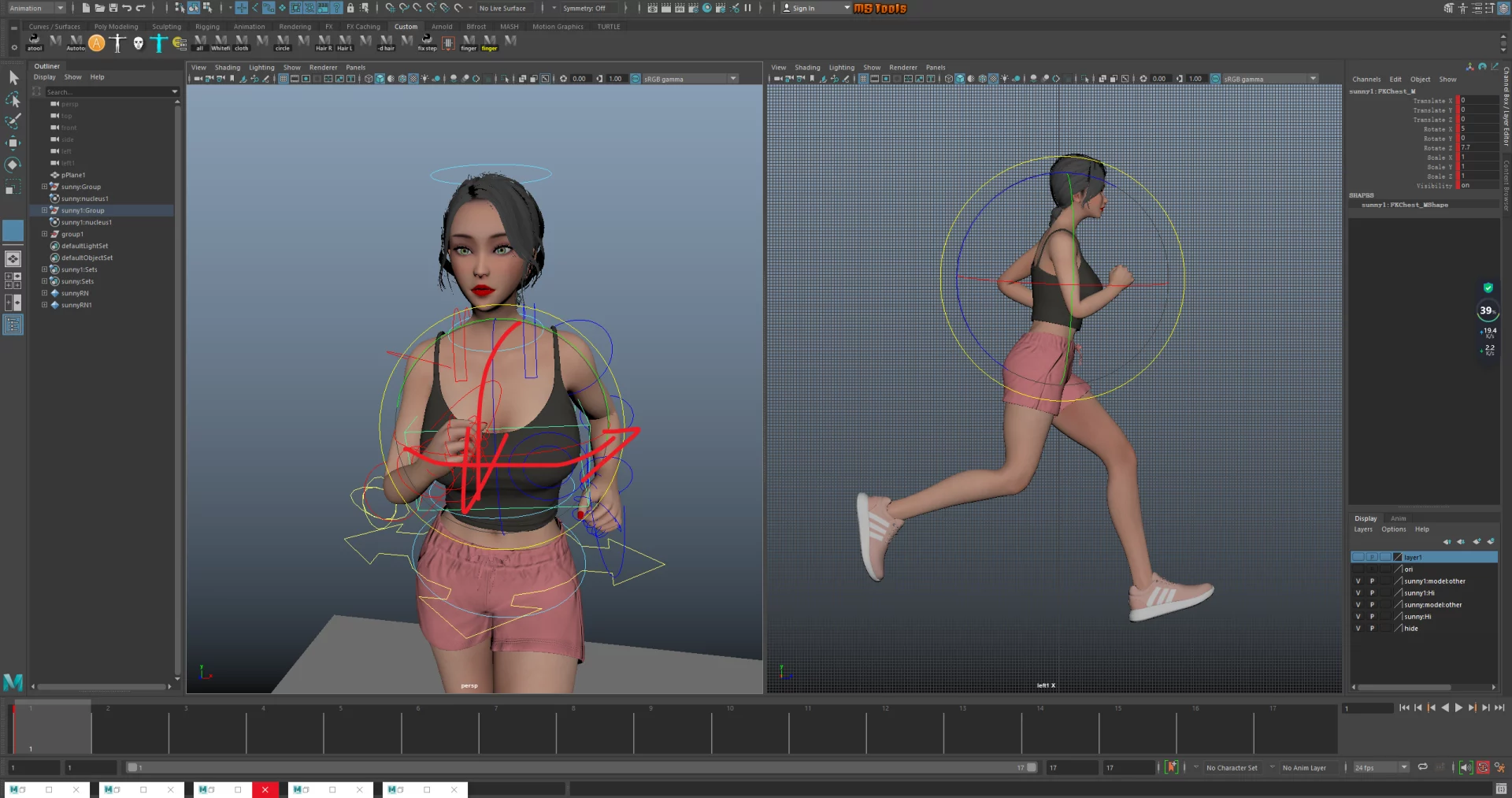

那么到这里这个跑步的雏形就出来了,我们现在适当的插入一些中间帧,增加一些变化。

我们来到第4帧,那么此时,我们身体会保持平衡,重心会微微的向后一点。然后腰部和胸部,由于踩地会向前弓一点点。然后双肩向下,手臂也向下摆动,头部我们也跟着做一点校正。

与此对应的12帧,也是一样的。重心会微微的向后一点。然后腰部和胸部,由于踩地会向前弓一点点。然后双肩向下,手臂也向下摆动,然后是头部做一些调整。

然后,这个手腕,我们在它向前抬起的时候做一个跟随,这样我们的手就看起来要软一些。

接着我们把肩部的控制器滞后,向后挪1帧,然后再第3帧设置关键帧,移动到第1帧,然后再把第1帧复制到最后一帧,保持pose连续性。

最后我们框选所有的控制器,我们给它们开启前后循环,然后我们挨个给他们做曲线修复调整,让动作衔接更加自然流畅。